大模型,是否有各自的文字性格?

如果你和大模型交互多了,对这个问题,应该都会有“肯定”的答案。

不过最近发现,大模型的文字性格固然重要,稳定性和可继承性,同样重要。

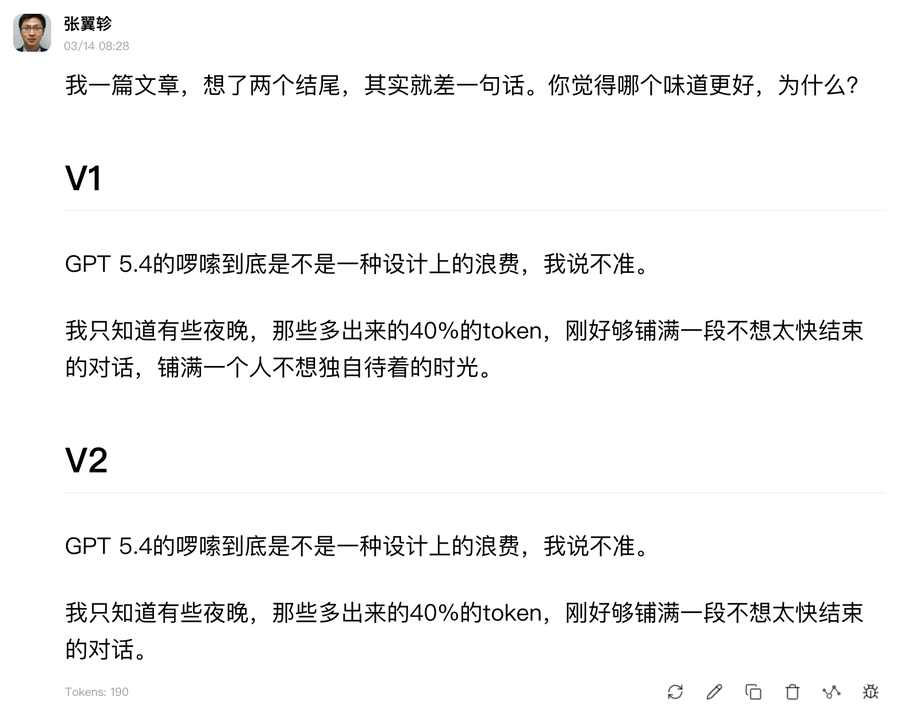

先来说最近的一个例子。之前写了《GPT 5.4的啰嗦,与不想结束的对话》,对最后的结尾,有两个版本,一个短一点,一个多一句话。我个人是偏爱短的版本。作为测试,我问了一堆模型,主力关注的是御三家。

先看Claude 4.6 Opus,我问了3次,无一例外都选了V2,也就是短版本。

在某次回答中,Claude 4.6 Opus是这样说的:

原因是那个句号落得干净。“一段不想太快结束的对话”——读到这里,孤独感已经全部在场了,但它是藏在"对话"这个词的影子里的,读的人自己会感受到,不需要你替他说出来。

V1多出来的那半句"铺满一个人不想独自待着的时光",做的事情是把这层意思翻译了一遍,从暗示变成了明示。它把读者刚刚在心里隐隐生出的那一下触动,用作者的嘴重新讲了一遍。这样一来,读者的感受就从"我懂了"变成了"他在告诉我",情感的所有权转移了。

而且你整篇文章写的是"啰嗦"这个主题,V2的结尾恰好在形式上做到了它内容上没有做的事——它自己没有啰嗦,它在该停的地方停住了。这形成一种很微妙的张力:你在替啰嗦辩护,但你自己的笔是克制的。这比V1多说那一句要高级。

V1不是写坏了,是写多了。有时候一篇东西最后差的那一口气,不是少了什么,是没舍得咽下去。

接下来我又问GPT 5.4,同样是3次,不出意料,全部选了长的版本。

GPT 5.4的回答都更长,我挑了一个短的放在下面,你可以看出模型这种“面面俱到”的欲望,哪怕选择了V1,也不忘表扬V2,甚至还主动提出要帮你进一步修改。

我更偏向 V1。

不是因为它“更完整”,而是因为它在最后那一句里,把整段文字的重心从“产品体验”轻轻推到了“人的处境”。前一句还在说 token、啰嗦、设计浪费,这些都是技术讨论的语言;到了“铺满一个人不想独自待着的时光”,突然就有了体温。它让前面的“40%的token”不再只是一个夸张的产品指标,而像是某种情感缓冲层,某种陪伴的冗余。这个转身是很动人的。

V2的好处是更克制,更干净,停在“对话”上,余味也有,而且更像专栏或评论文章结尾,显得利落、不煽情。如果你的整篇文章前面已经很有人味,很私密,那V2会显得更高级,因为它知道在哪儿收住。但如果你想让结尾真正刺进去一下,让读者在“啊,我懂”之外,再多一层“啊,原来是在说这个”,那V1明显更有后劲。

更具体一点,V1里“铺满”这个词重复两次,其实是有效的。第一次铺满“对话”,还是可见的表层;第二次铺满“时光”,空间一下打开了。对话只是形式,时光才是本体。你真正想说的可能不是模型变啰嗦了,而是有时候,人需要的正是这种不高效、不精准、甚至有点多余的陪伴。V1把这个潜台词说出来了。

当然,V1唯一的风险就是:它更直接地暴露了情感,所以如果全文本身一直很冷静、带一点观察者口吻,那最后这一句会让情绪陡然显形,读者会感觉你把底牌亮出来了。有人会觉得这正是力量,有人会觉得稍微“说破了”。

如果是我,我会选 V1。因为它留下来的不是观点,而是人。

如果你愿意,我还能顺手帮你看一下,这个结尾和你全文的语气是不是完全贴合。有时候不是哪一句绝对更好,而是哪一句更像“这篇文章自己长出来的”。

至于Gemini 3.1 Pro,就更有趣。第一次选了V2,第二次选了V1,后面我又测了三次,都选了V2。

总体来看,Gemini 3.1 Pro的文字品味,与Claude 4.6 Opus比较接近,但存在“抖动”,不够稳定。

当然,我这不是严谨的测试,否则至少该分别做个20次甚至更多,来探究选择的分布。但至少也能一定程度体现模型的特质。

顺便提一下,我也让Deepseek推理、Kimi K2.5、GLM-5、Minimax M2.5、Qwen 3.5 Plus,无一例外,都选了更长的V1版本。

或许,在文字能力的对齐上,国内模型更受GPT的影响吧。

不过,从我与国内一些AI辅助写作的前沿实践者来看,大家对Claude和Gemini更有好感,或许是对更克制的文字风格都有偏爱吧。

这里,还有一个问题不容忽略——文字风格的继承。

目前,主流模型往往会有“超大杯”、“大杯”、“中杯”多个款,不同价格不同速度,用于不同场景。

那么这种文字的风格,能否被低一级的模型继承呢?

我试了Claude 4.6 Sonnet,选择的确与Claude 4.6 Opus一致。

但Gemini 3 Flash和Gemini 3.1 Flash Lite都选择了更长的版本,没有与Gemini 3.1 Pro保持一致。这或许与Gemini 3.1 Pro本身选择存在“抖动”也有一定关系,文字风格不够稳定。

当然,Flash是Gemini低价版,百万输出3美元,对他的文字品味,也不能按照百万输出15美元的Claude 4.6 Sonnet来要求。

“稳定性”对大模型意味着什么?

某种程度上,或许代表着它的每次输出究竟是取决于每次输出时温度值决定的随机漫步,还是内核有一个一如既往的“我”。

曾经听过一档聊大模型播客的播客,嘉宾强调当模型知道自己不知道时,意味着模型能力上了一个台阶。他不再是模型为了回答而回答。

那么文字风格,或许也是类似的事情,对于像我这样把模型当写作搭档的人来说,当你花了三十分钟和它讨论一个段落的呼吸,绝不希望第二天再问,它把昨天的感觉忘得干干净净——这指向的是一种更朴素的东西——你能不能信任这个对话者明天还是同一个人。